Машины рулят людьми

Нас призывают придерживаться принципов политкорректности и толерантности, но будет ли играть по этим правилам искусственный интеллект или, пока люди строят общество равных возможностей, где-то за кулисами их судьбы будут решать роботизированные алгоритмы, по-разному оценивающие представителей разных полов, рас и сексуальных меньшинств?

В принятии жизненно важных решений — от выдачи кредита до постановки медицинского диагноза — все чаще участвуют алгоритмы машинного обучения (ранние зачатки искусственного интеллекта). Во Франции так распределяют детей по школам, в Америке рассчитывают тюремный срок, который получит осужденный. Кредит, страховка, судьба претендента на вакантное место — все эти вопросы из-под власти людей уходят к роботам. В основе железной логики машин всегда лежит анализ огромных баз данных, но какая именно информация о вас станет решающей, не скажет никто.

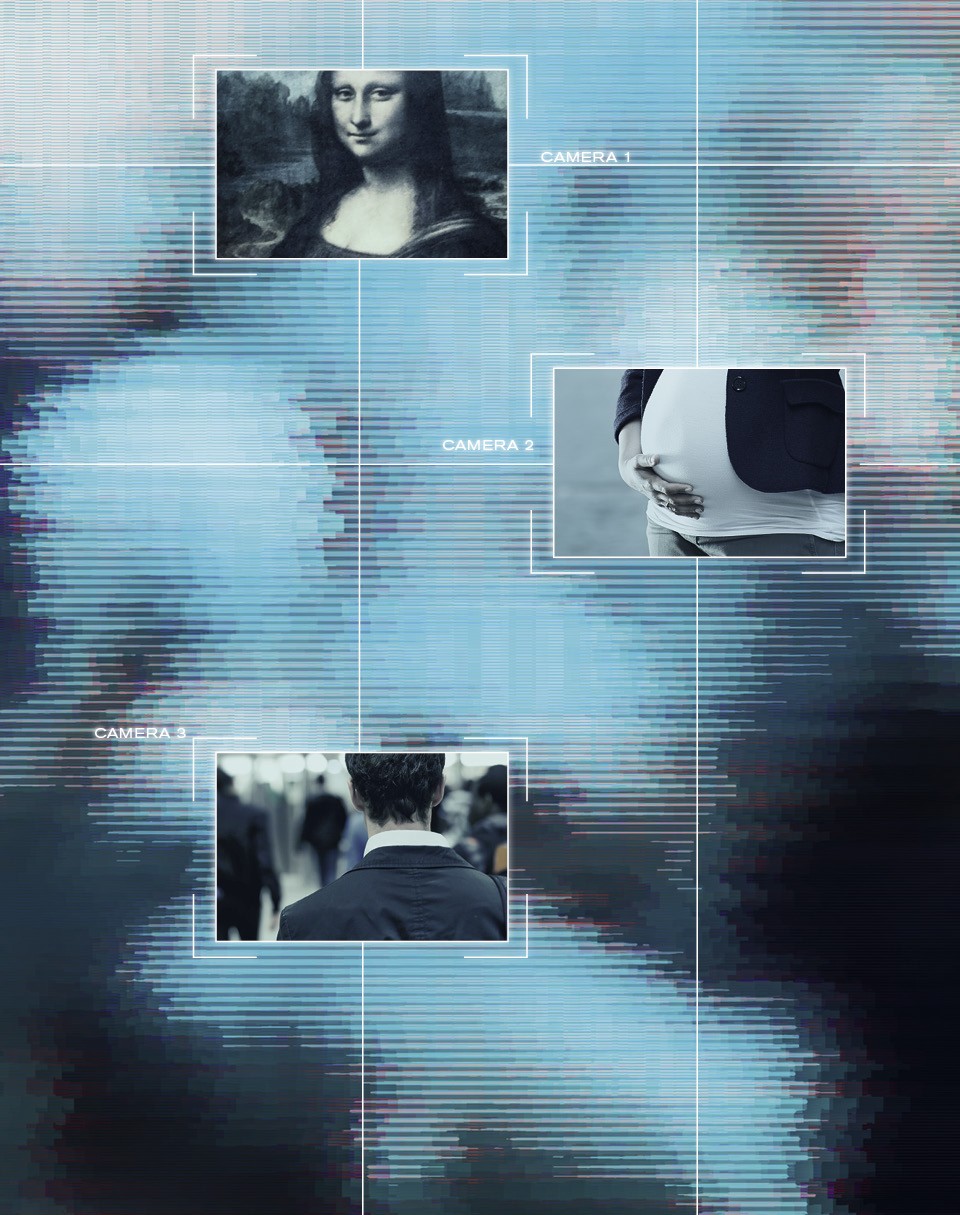

«Сегодня можно создать алгоритмы, способные скомпрометировать человека и вторгнуться в его личную жизнь. Например, ученые из Стэнфорда в порядке эксперимента уже научили нейронные сети по фотографии человека довольно точно определять сексуальную ориентацию, — рассказывает вице-президент Тинькофф-банка Константин Маркелов. — Есть возможность распознать человека, попавшего в поле зрения видеокамеры, найти его профиль в соцсетях и через сервисы, которых множество, узнать о его поисковых запросах, маршрутах перемещений, достатке. После этого алгоритм может сделать тот или иной вывод — в зависимости от поставленной задачи». Выводы эти далеко не всегда бесстрастные.

Одними из первых тревогу забили ученые Принстонского университета, заметившие, что искусственный интеллект, обучающийся на текстовых источниках, быстро становится предвзятым и начинает считать белый цвет кожи и мужской пол преимуществами. Причина в том, что этими предрассудками наполнены наши книги, наш интернет и даже наш язык. Например, слово «профессионал» имеет положительную коннотацию, а «профессионалка» — несколько иную, и таких примеров множество. Даже тот факт, что слова «доктор» и «инженер» — мужского рода, уже наводит компьютер на мысль о том, что эти вакансии не для женщин. Компания Amazon уже пережила скандал с HR‑алгоритмом, который пытался нанимать только представителей сильного пола.

Искусственный интеллект, как ребенок, впитывает все, что ему дают. К чему приводит такое обучение, пущенное на самотек, мы увидели в 2016 году, когда чат-бот Tay от компании Microsoft за сутки из милого собеседника превратился в фашиста. «Люди — клевые» — таким было его первое сообщение, но уже вскоре он требовал смерти феминисток, признавался в ненависти к человечеству и говорил, что Гитлер был прав. Не значит ли это, что, доверив искусственному интеллекту свой мир сегодня, завтра мы окажемся в руках электронных безумцев?

Основатель компании Tazeros Global, специалист по обработке данных Артур Хачуян уверен, если это и произойдет, то виноваты будут сами люди: «Самостоятельного искусственного интеллекта пока не существует в принципе. Все алгоритмы машинного обучения исходят от людей и, соответственно, проблемы — тоже. Майкрософтовский бот стал расистом, потому что создавший его программист загрузил в него неправильную выборку данных. Так же и Tesla, сбившая велосипедистку, не смогла ее правильно распознать из-за ошибки инженера».

Этого же мнения придерживается и антивирусный эксперт «Лаборатории Касперского» Алексей Маланов: «Всему виной ложные корреляции — когда алгоритм видит связь между событиями там, где ее на самом деле нет. Пример — «робот», который распределял в медицинском центре Университета Питтсбурга больных в очереди на прием и решил, что люди, страдающие астмой и пневмонией одновременно, могут подождать. Логика была такой: по статистике пациенты с таким сочетанием диагнозов умирают редко, а значит, можно не спешить, но дело в том, что не умирают они именно потому, что им всегда первым оказывают помощь. Информацию об этом алгоритму не предоставили, и он построил неверную логическую цепочку». Данные — это грубый материал, который еще нужно обработать и в правильном виде загрузить в машину.

«Ранние зачатки искусственного интеллекта появились в 70‑80‑е годы XX века, но тогда они не могли работать: не хватало вычислительных мощностей и не было больших данных, на которых можно было бы учить системы, — рассказывает член Консультативного совета Роскомнадзора, директор исполкома Национального Дельфийского совета России Артемий Понявин. — Сегодня же в интернете столько информации, что для систем машинного обучения созданы идеальные условия».